Comment la confidentialité de l’IA sécurise les plateformes ECM

Prévenez les fuites de données sensibles grâce à la confidentialité de l’IA. Les API sécurisées, les LLM privés et la protection des documents ECM peuvent protéger les données de votre entreprise.

Saviez-vous que 99 % des organisations ont exposé des données sensibles à des outils d’IA ?

Chaque fois que vous demandez à ChatGPT ou Claude de « résumer ceci » ou de « réviser cela », vous divulguez vos données.

La confidentialité de l’IA via des plateformes sécurisées et des clés API est la clé pour protéger votre organisation (et sa réputation !), en particulier dans les plateformes ECM.

Qu’est-ce que la confidentialité de l’IA dans la gestion de contenu d’entreprise (ECM) ?

La confidentialité de l’IA désigne la stratégie et les fonctionnalités utilisées au sein d’une plateforme de GED ou d’ECM pour protéger les données sensibles et éviter les failles de sécurité, en particulier lors de l’utilisation d’une gestion documentaire basée sur le cloud. La confidentialité de l’IA garantit que les modèles d’IA traitent les données de l’entreprise sans faire un mauvais usage des informations sensibles.

En d’autres termes, les données confidentielles restent protégées contre les utilisateurs humains mais aussi contre les systèmes d’IA eux-mêmes, même lorsque ces systèmes automatisent des tâches critiques comme la classification, l’indexation et la gestion des flux de travail.

Pour parvenir à la confidentialité de l’IA, les systèmes ECM mettent en place plusieurs fonctionnalités et stratégies, notamment :

- Environnements de traitement d’IA sécurisés

Les charges de travail d’IA sont effectuées dans des environnements isolés pour empêcher l’accès non autorisé aux données.

- Chiffrement

Les modèles d’IA traitent les données tout en maintenant un chiffrement de bout en bout, garantissant que le contenu sensible reste protégé en transit et au repos.

- Accès contrôlé aux modèles

Seuls les outils d’IA vérifiés et les modèles entraînés peuvent accéder à des ensembles de données spécifiques, minimisant ainsi le risque d’exposition.

L’IA confidentielle garantit que les données de l’entreprise restent protégées même lorsqu’elles sont analysées par des moteurs d’IA.

Par exemple, un document contenant une propriété intellectuelle exclusive peut être traité pour la classification ou l’automatisation des flux de travail avec un risque minimal lorsque des contrôles de sécurité et des politiques appropriés sont appliqués.

Pourquoi la confidentialité de l’IA est-elle importante dans votre ECM ?

Sans mesures de confidentialité de l’IA appropriées, les documents d’entreprise au sein des plateformes ECM sont exposés à un large éventail de risques.

Des informations sensibles peuvent être stockées ou mises en cache par inadvertance pendant le traitement de l’IA, créant des opportunités de fuite de données.

Des outils d’IA mal configurés pourraient également accéder à des documents au-delà de leur portée prévue, tandis que des employés ou des prestataires pourraient exploiter les systèmes d’IA pour obtenir un accès non autorisé, augmentant la menace de mauvais usage interne.

En outre, une mauvaise manipulation de contenu sensible peut entraîner une non-conformité réglementaire, violant potentiellement des normes telles que le RGPD, HIPAA, SOC 2 ou ISO 27001.

Une autre préoccupation courante est l’usage du « Shadow AI », où les employés exploitent des applications d’IA non autorisées qui pourraient involontairement exposer des documents confidentiels de l’entreprise en dehors de l’environnement sécurisé de l’ECM.

Comment utiliser les API pour une intégration d’IA sécurisée

Les API (Interfaces de Programmation d’Application) vous permettent d’intégrer des modèles d’IA directement dans les logiciels de votre entreprise, et offrent par conséquent un meilleur contrôle sur la confidentialité des données, les coûts et les fonctionnalités.

Que se passe-t-il lorsque vous vous fiez à des agents conversationnels d’IA publics au lieu des API ?

Lorsque vous utilisez des chatbots publics pendant votre journée de travail, vous effectuez parfois des requêtes telles que « résumer ce document », « corriger la grammaire », « répondre à cet e-mail ».

Et bien que cela semble assez innocent, les interactions peuvent être enregistrées ou utilisées pour améliorer les modèles, à moins que des paramètres de confidentialité d’entreprise ne soient appliqués.

Les chatbots d’IA publics tels qu’OpenAI, Anthropic ou Gemini, par exemple, proposent généralement un abonnement simple ou un modèle gratuit. Dans de nombreux cas, les interactions avec ces outils peuvent être journalisées et utilisées pour améliorer les LLM sous-jacents.

Pour cette raison, les informations saisies dans les interfaces de chat publiques ne doivent généralement pas être considérées comme confidentielles.

Si vous utilisez ces chatbots à un niveau plus professionnel, vous devriez envisager d’utiliser des services d’API payants qui offrent des contrôles de confidentialité plus stricts et des politiques de conservation des données configurables.

Au lieu d’un chatbot basé sur un abonnement, l’accès à l’API fonctionne selon un modèle de paiement par requête utilisant des jetons. Ces jetons représentent des unités de texte traitées par le modèle d’IA.

Ainsi, chaque requête d’API aura un coût minime (généralement quelques centimes).

Les interactions par API n’impliquent généralement pas de révision humaine, et les configurations d’entreprise peuvent empêcher les données d’être utilisées pour entraîner des modèles.

Cette approche offre un meilleur contrôle, une transparence des coûts et des protections de confidentialité renforcées.

Clés API et intégration sécurisée

L’accès aux modèles d’IA via des API nécessite l’utilisation d’une clé API, qui agit comme un identifiant sécurisé similaire à un mot de passe.

Après avoir créé un compte chez un fournisseur tel qu’Anthropic, vous pouvez acheter des jetons (par exemple, un solde prépayé) et générer une clé API.

La clé API permet aux systèmes logiciels internes de se connecter en toute sécurité au service d’IA. Une fois connecté, l’IA peut effectuer le résumé de documents, la révision de documents, l’analyse de données, l’automatisation des flux de travail et d’autres tâches similaires.

Comme la connexion API s’effectue directement entre le logiciel de l’organisation et le service d’IA, elle peut fonctionner dans des environnements sécurisés et chiffrés, de sorte que vos documents confidentiels restent protégés.

Gestion des coûts des API et risques de sécurité

Bien que les clés API soient faciles à générer, vous devez les gérer avec soin. Une utilisation inappropriée peut entraîner des coûts inattendus ou des risques de sécurité.

Les modèles de facturation des API sont généralement assez simples :

- Jetons prépayés : les organisations achètent à l’avance une quantité fixe d’utilisation.

- Limites de recharge automatique : les soldes se rechargent automatiquement lorsqu’ils tombent en dessous d’un certain seuil.

- Facturation mensuelle : l’utilisation est facturée à la fin du cycle de facturation.

Cependant, le modèle de facturation mensuelle peut introduire des risques si une clé API est compromise.

Comme les clés API fonctionnent de manière similaire à un numéro de carte de crédit, une clé volée pourrait générer des milliers de requêtes et entraîner des frais inattendus importants.

Pour cette raison, les meilleures pratiques incluent :

- Stocker les clés API de manière sécurisée

- Limiter l’utilisation avec des plafonds de dépenses

- Effectuer une rotation périodique des clés

- Restreindre l’accès à l’API au sein d’une infrastructure sécurisée

Malgré les idées reçues selon lesquelles l’IA est toujours gratuite, l’utilisation de l’IA en entreprise implique toujours des coûts opérationnels, et une utilisation d’API non surveillée pourrait s’intensifier rapidement si elle est mal configurée.

Déploiements de LLM privés

Une autre option pour une confidentialité maximale consiste à déployer un LLM privé au sein de la propre infrastructure de votre organisation.

Dans ce modèle, le système d’IA fonctionne entièrement sur des serveurs locaux plutôt que via des API externes.

Comme le modèle et les données restent internes, les documents confidentiels ne quittent jamais l’environnement de l’organisation.

Cependant, le déploiement d’un LLM privé nécessite des ressources informatiques importantes, notamment des GPU haute performance, une grande mémoire système et une infrastructure d’IA dédiée.

Cela rend les déploiements de LLM privés plus coûteux et techniquement exigeants que les solutions basées sur des API, mais plus sécurisés si vous traitez des documents hautement confidentiels ou sensibles.

Comment les documents confidentiels restent-ils sécurisés au sein d’une GED ?

Les plateformes de GED modernes, en particulier les systèmes ECM compatibles avec l’IA comme Dokmee, utilisent plusieurs couches de sécurité pour préserver la confidentialité des documents.

Avant tout, Dokmee ECM possède une architecture basée sur des API qui combine chiffrement et journalisation d’audit pour traiter les tâches d’IA tout en gardant les données confidentielles.

Les requêtes sont transmises de manière sécurisée, traitées par le moteur d’IA et renvoyées sans exposer les documents sous-jacents à des tiers.

Cette architecture vous permet de bénéficier de l’automatisation pilotée par l’IA tout en protégeant les données sensibles au sein de l’environnement ECM.

En utilisant les API de manière responsable, vous pouvez recourir à des tâches d’IA avancées à un coût minimal par requête tout en maintenant les normes de confidentialité strictes requises pour la gestion de contenu d’entreprise.

Dokmee utilise également ces 5 mesures de sécurité pour accroître la confidentialité :

1. Contrôle d’accès basé sur les rôles (RBAC)

Le RBAC applique des autorisations granulaires au niveau du document, garantissant que seuls les utilisateurs autorisés peuvent consulter, modifier ou partager du contenu.

Les départements et les projets peuvent avoir des restrictions d’accès personnalisées, et le principe du moindre privilège garantit que les employés n’accèdent qu’aux fichiers nécessaires à leurs fonctions.

La confidentialité de l’IA commence par des politiques de contrôle d’accès strictes au sein de la GED, formant la base d’une gestion sécurisée du contenu d’entreprise.

2. Chiffrement au repos et en transit

Les documents sont chiffrés à la fois pendant le stockage et la transmission.

Le protocole SSL (Secure Sockets Layer) et le TLS ( Transport Layer Security) protègent les données circulant sur les réseaux, tandis que le chiffrement au niveau de la base de données protège les informations stockées. Les sauvegardes chiffrées et le stockage cloud réduisent davantage les risques.

L’IA confidentielle s’appuie sur des pipelines de données chiffrés pour empêcher l’exposition pendant le traitement, garantissant que même les flux de travail pilotés par l’IA ne peuvent compromettre le contenu sensible.

3. Classification intelligente des documents propulsée par l’IA

L’IA classifie automatiquement les documents en fonction de la sensibilité du contenu, grâce au traitement du langage naturel et à l’ indexation par l’IA.

En utilisant un traitement avancé du langage naturel et la reconnaissance de motifs, l’IA confidentielle peut détecter des informations exclusives, des données d’identification personnelle ou de la propriété intellectuelle, et appliquer des politiques automatisées pour restreindre l’accès.

L’IA confidentielle renforce la sécurité des documents en identifiant et en protégeant automatiquement le contenu sensible, réduisant ainsi l’erreur humaine dans l’étiquetage ou la manipulation de documents confidentiels.

4. Surveillance comportementale et détection d’anomalies

La confidentialité de l’IA transforme la sécurité de l’ECM d’un audit réactif en une détection proactive des menaces.

En surveillant les modèles d’accès aux fichiers, les volumes de téléchargement et les modifications d’autorisations, l’IA peut détecter des anomalies telles que des téléchargements massifs inhabituels ou des tentatives d’accès en dehors des heures de travail normales.

Cela permet aux administrateurs de répondre immédiatement aux violations potentielles ou aux utilisations abusives.

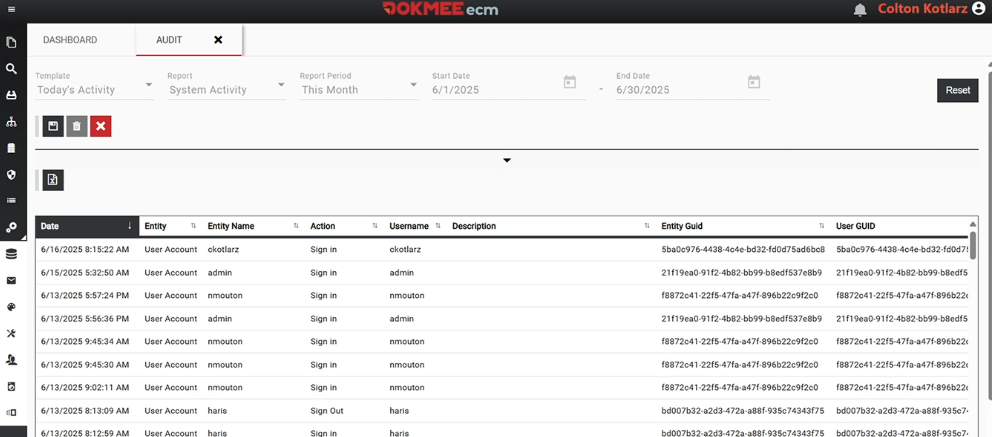

5. Pistes d’audit

L’historique complet des documents, les journaux d’activité de l’IA et la responsabilité au niveau de l’utilisateur offrent une couche de sécurité supplémentaire.

Les organisations peuvent suivre chaque action effectuée sur un document, de la consultation et la modification au partage et à la suppression, ce qui facilite les rapports de conformité et les enquêtes internes.

De plus, les pistes d’audit ne peuvent être modifiées à aucun moment.

Comment Dokmee soutient la confidentialité de l’IA

Dokmee ECM est un excellent exemple de plateforme de gestion de contenu d’entreprise prête pour l’IA qui prend en charge la gestion confidentielle des documents d’entreprise.

Certaines des fonctionnalités de sécurité incluent :

- Autorisations utilisateur granulaires qui appliquent les politiques RBAC

- Options de déploiement sécurisées sur le cloud et sur site

- Normes de chiffrement avancées pour les données au repos et en transit

- Contrôle de version pour protéger l’intégrité des documents

- Contrôle d’accès basé sur le flux de travail pour les processus d’approbation

- Partage externe sécurisé avec protection par mot de passe, expiration et suivi

Ces fonctionnalités garantissent que les organisations peuvent mettre en œuvre des stratégies d’IA confidentielle sans sacrifier la facilité d’utilisation ou l’efficacité des flux de travail.

Protégez vos données avec la confidentialité de l’IA

La confidentialité de l’IA répond à vos défis de sécurité en protégeant vos documents et vos flux de travail contre les menaces possibles.

L’automatisation intelligente maintient des normes de confidentialité et de sécurité strictes.

En mettant en œuvre des contrôles d’accès granulaires, le chiffrement, la classification assistée par l’IA, des environnements de traitement sécurisés et un audit complet, vous pouvez garantir que vos documents confidentiels restent protégés.

Dokmee offre un cadre moderne et prêt pour l’IA pour soutenir ces stratégies, faisant de l’IA confidentielle un avantage stratégique dans la gestion de contenu d’entreprise.

Contactez nos experts ECM d’entreprise

Planifiez votre démonstration gratuite – n’importe quand, n’importe où

Faites l’expérience de l’ECM d’entreprise sans frais cachés et avec un retour sur investissement immédiat :

- Rappel immédiat 24 heures sur 24 – vous choisissez l’heure.

- Adapté à vos flux de travail – pas de présentations à l’emporte-pièce.

- Retour sur investissement en 60 jours – la plupart des entreprises récupèrent rapidement les coûts.

« Dokmee a réduit notre temps de recherche de 70% – nous avons vu le retour sur investissement en 45 jours.

Chad P., CTO