Cómo la privacidad de la IA asegura las plataformas ECM

Evite las filtraciones de datos sensibles gracias a la privacidad de la IA. Las API seguras, los LLM privados y la protección de documentos ECM pueden proteger los datos de su empresa.

¿Sabía que el 99 % de las organizaciones han expuesto datos sensibles a herramientas de IA?

Cada vez que le pide a ChatGPT o Claude que «resuma esto» o «revise aquello», está divulgando sus datos.

La privacidad de la IA a través de plataformas seguras y claves API es la clave para proteger a su organización (¡y su reputación!), especialmente en las plataformas ECM.

¿Qué es la privacidad de la IA en la gestión de contenido empresarial (ECM)?

La privacidad de la IA se refiere a la estrategia y las funcionalidades utilizadas dentro de una plataforma de gestión documental o ECM para proteger los datos sensibles y evitar brechas de seguridad, especialmente al utilizar una gestión documental basada en la nube. La privacidad de la IA garantiza que los modelos de IA procesen los datos de la empresa sin hacer un mal uso de la información sensible.

En otras palabras, los datos confidenciales permanecen protegidos frente a los usuarios humanos, pero también frente a los propios sistemas de IA, incluso cuando estos sistemas automatizan tareas críticas como la clasificación, la indexación y la gestión de flujos de trabajo.

Para lograr la privacidad de la IA, los sistemas ECM implementan varias funcionalidades y estrategias, entre ellas:

- Entornos de procesamiento de IA seguros

Las cargas de trabajo de IA se realizan en entornos aislados para evitar el acceso no autorizado a los datos.

- Cifrado

Los modelos de IA procesan los datos manteniendo un cifrado de extremo a extremo, garantizando que el contenido sensible permanezca protegido en tránsito y en reposo.

- Acceso controlado a los modelos

Solo las herramientas de IA verificadas y los modelos entrenados pueden acceder a conjuntos de datos específicos, minimizando así el riesgo de exposición.

La IA confidencial garantiza que los datos de la empresa permanezcan protegidos incluso cuando son analizados por motores de IA.

Por ejemplo, un documento que contenga propiedad intelectual exclusiva puede procesarse para la clasificación o la automatización de flujos de trabajo con un riesgo mínimo cuando se aplican los controles de seguridad y las políticas adecuadas.

¿Por qué es importante la privacidad de la IA en su ECM?

Sin las medidas de privacidad de la IA adecuadas, los documentos empresariales dentro de las plataformas ECM están expuestos a una amplia gama de riesgos.

La información sensible puede almacenarse o guardarse en caché inadvertidamente durante el procesamiento de la IA, lo que crea oportunidades para la filtración de datos.

Las herramientas de IA mal configuradas también podrían acceder a documentos más allá de su alcance previsto, mientras que los empleados o contratistas podrían explotar los sistemas de IA para obtener un acceso no autorizado, aumentando la amenaza de uso indebido interno.

Además, el manejo inadecuado de contenido sensible puede provocar el incumplimiento normativo, violando potencialmente estándares como el RGPD, HIPAA, SOC 2 o ISO 27001.

Otra preocupación común es el uso de la «Shadow AI» (IA en la sombra), donde los empleados utilizan aplicaciones de IA no autorizadas que podrían exponer involuntariamente documentos confidenciales de la empresa fuera del entorno seguro del ECM.

Cómo utilizar las API para una integración de IA segura

Las API (Interfaces de Programación de Aplicaciones) le permiten integrar modelos de IA directamente en el software de su empresa y, por lo tanto, ofrecen un mejor control sobre la privacidad de los datos, los costos y las funcionalidades.

¿Qué sucede cuando confía en agentes conversacionales de IA públicos en lugar de en las API?

Cuando utiliza chatbots públicos durante su jornada laboral, a veces realiza solicitudes como «resumir este documento», «corregir la gramática» o «responder a este correo electrónico».

Y aunque esto parezca bastante inocente, las interacciones pueden registrarse o utilizarse para mejorar los modelos, a menos que se apliquen configuraciones de privacidad empresarial.

Los chatbots de IA públicos como OpenAI, Anthropic o Gemini, por ejemplo, suelen ofrecer una suscripción sencilla o un modelo gratuito. En muchos casos, las interacciones con estas herramientas pueden registrarse y utilizarse para mejorar los LLM subyacentes.

Por esta razón, la información introducida en las interfaces de chat públicas generalmente no debe considerarse confidencial.

Si utiliza estos chatbots a un nivel más profesional, debería considerar el uso de servicios de API de pago que ofrecen controles de privacidad más estrictos y políticas de retención de datos configurables.

En lugar de un chatbot basado en suscripción, el acceso a la API funciona bajo un modelo de pago por solicitud mediante tokens. Estos tokens representan unidades de texto procesadas por el modelo de IA.

De esta manera, cada solicitud de API tendrá un costo mínimo (generalmente unos pocos céntimos).

Las interacciones por API generalmente no implican una revisión humana, y las configuraciones empresariales pueden evitar que los datos se utilicen para entrenar modelos.

Este enfoque ofrece un mejor control, transparencia de costos y protecciones de privacidad reforzadas.

Claves API e integración segura

El acceso a los modelos de IA a través de API requiere el uso de una clave API, que actúa como un identificador seguro similar a una contraseña.

Tras crear una cuenta con un proveedor como Anthropic, puede comprar tokens (por ejemplo, un saldo prepago) y generar una clave API.

La clave API permite que los sistemas de software internos se conecten de forma segura al servicio de IA. Una vez conectada, la IA puede realizar el resumen de documentos, la revisión de documentos, el análisis de datos, la automatización de flujos de trabajo y otras tareas similares.

Dado que la conexión API se realiza directamente entre el software de la organización y el servicio de IA, puede funcionar en entornos seguros y cifrados, de modo que sus documentos confidenciales permanezcan protegidos.

Gestión de costos de las API y riesgos de seguridad

Aunque las claves API son fáciles de generar, debe gestionarlas con cuidado. Un uso inadecuado puede conllevar costos inesperados o riesgos de seguridad.

Los modelos de facturación de las API suelen ser bastante sencillos:

- Tokens prepagados: las organizaciones compran por adelantado una cantidad fija de uso.

- Límites de recarga automática: los saldos se recargan automáticamente cuando caen por debajo de un cierto umbral.

- Facturación mensual: el uso se factura al final del ciclo de facturación.

Sin embargo, el modelo de facturación mensual puede introducir riesgos si una clave API se ve comprometida.

Como las claves API funcionan de manera similar al número de una tarjeta de crédito, una clave robada podría generar miles de solicitudes y dar lugar a cargos inesperados importantes.

Por esta razón, las mejores prácticas incluyen:

- Almacenar las claves API de forma segura

- Limitar el uso con topes de gasto

- Realizar una rotación periódica de las claves

- Restringir el acceso a la API dentro de una infraestructura segura

A pesar de la creencia popular de que la IA siempre es gratuita, el uso de la IA en la empresa siempre conlleva costos operativos, y un uso de la API sin supervisión podría escalar rápidamente si se configura incorrectamente.

Despliegues de LLM privados

Otra opción para una privacidad máxima consiste en desplegar un LLM privado dentro de la propia infraestructura de su organización.

En este modelo, el sistema de IA funciona completamente en servidores locales en lugar de a través de API externas.

Como el modelo y los datos permanecen internos, los documentos confidenciales nunca abandonan el entorno de la organización.

Sin embargo, el despliegue de un LLM privado requiere recursos informáticos importantes, incluidos GPU de alto rendimiento, una gran memoria de sistema e infraestructura de IA dedicada.

Esto hace que los despliegues de LLM privados sean más costosos y técnicamente exigentes que las soluciones basadas en API, pero más seguros si procesa documentos altamente confidenciales o sensibles.

¿Cómo se mantienen seguros los documentos confidenciales dentro de un gestor documental?

Las plataformas de gestión documental modernas, especialmente los sistemas ECM compatibles con la IA como Dokmee, utilizan varias capas de seguridad para preservar la confidencialidad de los documentos.

Ante todo, Dokmee ECM posee una arquitectura basada en API que combina cifrado y registros de auditoría para procesar tareas de IA manteniendo los datos confidenciales.

Las solicitudes se transmiten de forma segura, se procesan mediante el motor de IA y se devuelven sin exponer los documentos subyacentes a terceros.

Esta arquitectura le permite beneficiarse de la automatización impulsada por la IA al tiempo que protege los datos sensibles dentro del entorno ECM.

Al utilizar las API de manera responsable, puede recurrir a tareas de IA avanzadas con un costo mínimo por solicitud, manteniendo los estrictos estándares de privacidad requeridos para la gestión de contenido empresarial.

Dokmee también utiliza estas 5 medidas de seguridad para aumentar la privacidad:

1. Control de acceso basado en roles (RBAC)

El RBAC aplica permisos granulares a nivel de documento, garantizando que solo los usuarios autorizados puedan ver, editar o compartir contenido.

Los departamentos y proyectos pueden tener restricciones de acceso personalizadas, y el principio de menor privilegio garantiza que los empleados solo accedan a los archivos necesarios para sus funciones.

La privacidad de la IA comienza con políticas de control de acceso estrictas dentro del gestor documental, formando la base de una gestión segura del contenido empresarial.

2. Cifrado en reposo y en tránsito

Los documentos se cifran tanto durante el almacenamiento como durante la transmisión.

Los protocolos SSL (Secure Sockets Layer) y TLS (Transport Layer Security) protegen los datos que circulan por las redes, mientras que el cifrado a nivel de base de datos protege la información almacenada. Las copias de seguridad cifradas y el almacenamiento en la nube reducen aún más los riesgos.

La IA confidencial se apoya en canales de datos cifrados para evitar la exposición durante el procesamiento, garantizando que incluso los flujos de trabajo impulsados por la IA no puedan comprometer el contenido sensible.

3. Clasificación inteligente de documentos impulsada por IA

La IA clasifica automáticamente los documentos en función de la sensibilidad del contenido, gracias al procesamiento del lenguaje natural y a la indexación por IA.

Mediante el uso de un procesamiento avanzado del lenguaje natural y el reconocimiento de patrones, la IA confidencial puede detectar información patentada, datos de identificación personal o propiedad intelectual, y aplicar políticas automatizadas para restringir el acceso.

La IA confidencial refuerza la seguridad de los documentos al identificar y proteger automáticamente el contenido sensible, reduciendo así el error humano en el etiquetado o la manipulación de documentos confidenciales.

4. Monitoreo del comportamiento y detección de anomalías

La privacidad de la IA transforma la seguridad del ECM de una auditoría reactiva a una detección proactiva de amenazas.

Al monitorear los patrones de acceso a los archivos, los volúmenes de descarga y los cambios de permisos, la IA puede detectar anomalías como descargas masivas inusuales o intentos de acceso fuera de las horas de trabajo normales.

Esto permite a los administradores responder de inmediato a posibles infracciones o usos indebidos.

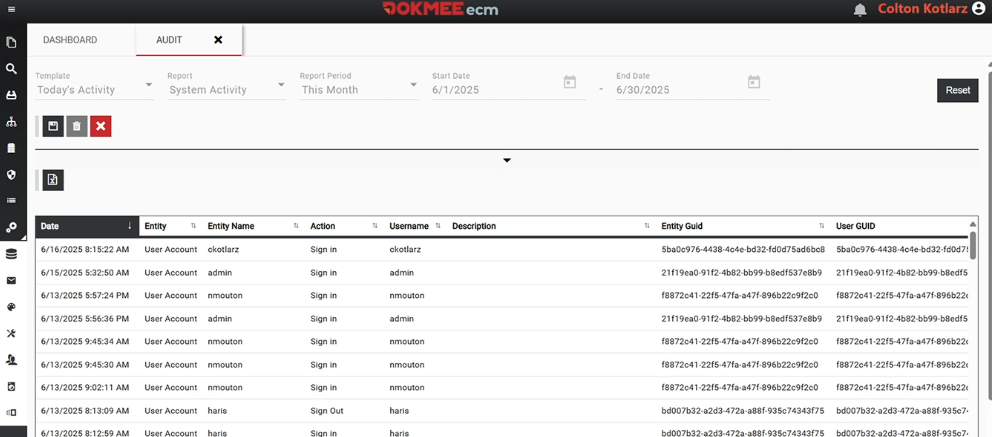

5. Pistas de auditoría

El historial completo de los documentos, los registros de actividad de la IA y la responsabilidad a nivel de usuario ofrecen una capa de seguridad adicional.

Las organizaciones pueden rastrear cada acción realizada en un documento, desde la visualización y edición hasta el intercambio y la eliminación, lo que facilita los informes de cumplimiento y las investigaciones internas.

Además, las pistas de auditoría no pueden modificarse en ningún momento.

Cómo Dokmee apoya la privacidad de la IA

Dokmee ECM es un excelente ejemplo de una plataforma de gestión de contenido empresarial lista para la IA que admite la gestión confidencial de documentos empresariales.

Algunas de las características de seguridad incluyen:

- Permisos de usuario granulares que aplican las políticas RBAC

- Opciones de despliegue seguras en la nube y en las instalaciones (on-premise)

- Estándares de cifrado avanzados para datos en reposo y en tránsito

- Control de versiones para proteger la integridad de los documentos

- Control de acceso basado en flujos de trabajo para procesos de aprobación

- Intercambio externo seguro con protección por contraseña, caducidad y seguimiento

Estas características garantizan que las organizaciones puedan implementar estrategias de IA confidencial sin sacrificar la facilidad de uso o la eficiencia de los flujos de trabajo.

Proteja sus datos con la privacidad de la IA

La privacidad de la IA responde a sus desafíos de seguridad protegiendo sus documentos y sus flujos de trabajo contra posibles amenazas.

La automatización inteligente mantiene estrictos estándares de privacidad y seguridad.

Al implementar controles de acceso granulares, cifrado, clasificación asistida por IA, entornos de procesamiento seguros y una auditoría completa, puede garantizar que sus documentos confidenciales permanezcan protegidos.

Dokmee ofrece un marco moderno y listo para la IA para apoyar estas estrategias, convirtiendo la IA confidencial en una ventaja estratégica en la gestión de contenido empresarial.

Póngase en contacto con nuestros expertos en ECM empresarial

Programe su demostración gratuita—en cualquier momento y lugar

Experimente ECM de nivel empresarial sin tarifas ocultas y con un retorno de la inversión inmediato:

- Devolución de llamada instantánea en 24 horas: usted elige la hora.

- Adaptado a sus flujos de trabajo, sin propuestas predefinidas.

- ROI en 60 días: la mayoría de las empresas recuperan los costes rápidamente.

“Dokmee redujo nuestro tiempo de recuperación en un 70%: vimos el ROI en 45 días”.

Chad P., CTO