Como a privacidade da IA protege as plataformas ECM

Evite vazamentos de dados sensíveis graças à privacidade da IA. APIs seguras, LLMs privados e proteção de documentos ECM podem proteger os dados da sua empresa.

Sabia que 99% das organizações expuseram dados sensíveis a ferramentas de IA?

Sempre que pede ao ChatGPT ou Claude para «resumir isto» ou «rever aquilo», está a divulgar os seus dados.

A privacidade da IA através de plataformas seguras e chaves de API é a chave para proteger a sua organização (e a sua reputação!), especialmente nas plataformas ECM.

O que é a privacidade da IA na gestão de conteúdo empresarial (ECM)?

A privacidade da IA refere-se à estratégia e às funcionalidades utilizadas numa plataforma de gestão documental ou ECM para proteger os dados sensíveis e evitar brechas de segurança, especialmente ao utilizar uma gestão documental baseada na nuvem. A privacidade da IA garante que os modelos de IA processem os dados da empresa sem fazer um uso indevido da informação sensível.

Por outras palavras, os dados confidenciais permanecem protegidos contra utilizadores humanos, mas também contra os próprios sistemas de IA, mesmo quando estes sistemas automatizam tarefas críticas como a classificação, a indexação e a gestão de fluxos de trabalho.

Para alcançar a privacidade da IA, os sistemas ECM implementam várias funcionalidades e estratégias, incluindo:

- Ambientes de processamento de IA seguros

As cargas de trabalho de IA são realizadas em ambientes isolados para evitar o acesso não autorizado aos dados.

- Criptografia

Os modelos de IA processam os dados mantendo uma criptografia de ponta a ponta, garantindo que o conteúdo sensível permaneça protegido em trânsito e em repouso.

- Acesso controlado aos modelos

Apenas ferramentas de IA verificadas e modelos treinados podem aceder a conjuntos de dados específicos, minimizando o risco de exposição.

A IA confidencial garante que os dados da empresa permaneçam protegidos mesmo quando são analisados por motores de IA.

Por exemplo, um documento que contenha propriedade intelectual exclusiva pode ser processado para classificação ou automação de fluxos de trabalho com risco mínimo quando os controlos de segurança e as políticas adequadas são aplicados.

Por que é que a privacidade da IA é importante no seu ECM?

Sem as medidas de privacidade da IA adequadas, os documentos empresariais dentro das plataformas ECM ficam expostos a uma vasta gama de riscos.

A informação sensível pode ser armazenada ou guardada em cache inadvertidamente durante o processamento da IA, o que cria oportunidades para a fuga de dados.

Ferramentas de IA mal configuradas também poderiam aceder a documentos para além do seu âmbito pretendido, enquanto funcionários ou contratados poderiam explorar os sistemas de IA para obter acesso não autorizado, aumentando a ameaça de uso indevido interno.

Além disso, o manuseio inadequado de conteúdo sensível pode levar ao incumprimento regulamentar, violando potencialmente normas como o RGPD, HIPAA, SOC 2 ou ISO 27001.

Outra preocupação comum é o uso da «Shadow AI» (IA na sombra), onde os funcionários utilizam aplicações de IA não autorizadas que poderiam expor involuntariamente documentos confidenciais da empresa fora do ambiente seguro do ECM.

Como utilizar as APIs para uma integração de IA segura

As APIs (Interfaces de Programação de Aplicações) permitem integrar modelos de IA diretamente no software da sua empresa e, por isso, oferecem um melhor controlo sobre a privacidade dos dados, os custos e as funcionalidades.

O que acontece quando confia em agentes conversacionais de IA públicos em vez das APIs?

Quando utiliza chatbots públicos durante o seu dia de trabalho, por vezes faz pedidos como «resumir este documento», «corrigir a gramática» ou «responder a este e-mail».

E embora isto pareça bastante inocente, as interações podem ser registadas ou utilizadas para melhorar os modelos, a menos que as configurações de privacidade empresarial sejam aplicadas.

Os chatbots de IA públicos, como o OpenAI, Anthropic ou Gemini, por exemplo, oferecem frequentemente uma subscrição simples ou um modelo gratuito. Em muitos casos, as interações com estas ferramentas podem ser registadas e utilizadas para melhorar os LLMs subjacentes.

Por esta razão, a informação inserida nas interfaces de chat públicas geralmente não deve ser considerada confidencial.

Se utiliza estes chatbots a um nível mais profissional, deve considerar o uso de serviços de API pagos que oferecem controlos de privacidade mais rigorosos e políticas de retenção de dados configuráveis.

Em vez de um chatbot baseado em subscrição, o acesso à API funciona sob um modelo de pagamento por pedido através de tokens. Estes tokens representam unidades de texto processadas pelo modelo de IA.

Desta forma, cada pedido de API terá um custo mínimo (geralmente alguns cêntimos).

As interações por API geralmente não envolvem revisão humana, e as configurações empresariais podem impedir que os dados sejam utilizados para treinar modelos.

Esta abordagem oferece um melhor controlo, transparência de custos e proteções de privacidade reforzadas.

Chaves de API e integração segura

O acesso aos modelos de IA através de API requer o uso de uma chave de API, que funciona como um identificador seguro semelhante a uma palavra-passe.

Após criar uma conta num fornecedor como a Anthropic, pode comprar tokens (por exemplo, um saldo pré-pago) e gerar uma chave de API.

A chave de API permite que os sistemas de software internos se liguem de forma segura ao serviço de IA. Uma vez ligada, a IA pode realizar o resumo de documentos, revisão de documentos, análise de dados, automação de fluxos de trabalho e outras tarefas semelhantes.

Dado que a ligação de API é feita diretamente entre o software da organização e o serviço de IA, esta pode funcionar em ambientes seguros e criptografados, de modo que os seus documentos confidenciais permaneçam protegidos.

Gestão de custos das APIs e riscos de segurança

Embora as chaves de API sejam fáceis de gerar, deve geri-las com cuidado. Um uso indevido pode levar a custos inesperados ou riscos de segurança.

Os modelos de faturação das APIs costumam ser bastante simples:

- Tokens pré-pagos: as organizações compram antecipadamente uma quantidade fixa de utilização.

- Limites de carregamento automático: os saldos são recarregados automaticamente quando descem abaixo de um determinado limite.

- Faturação mensal: a utilização é faturada no final do ciclo de faturação.

No entanto, o modelo de faturação mensal pode introduzir riscos se uma chave de API for comprometida.

Como as chaves de API funcionam de forma semelhante ao número de um cartão de crédito, uma chave roubada pode gerar milhares de pedidos e resultar em cobranças inesperadas significativas.

Por esta razão, as melhores práticas incluem:

- Armazenar as chaves de API de forma segura

- Limitar a utilização com limites de gastos

- Realizar uma rotação periódica das chaves

- Restringir o acesso à API dentro de uma infraestrutura segura

Apesar da crença popular de que a IA é sempre gratuita, o uso da IA na empresa acarreta sempre custos operacionais, e uma utilização da API sem supervisão pode escalar rapidamente se for configurada incorretamente.

Implementações de LLM privados

Outra opção para uma privacidade máxima consiste em implementar um LLM privado dentro da própria infraestrutura da sua organização.

Neste modelo, o sistema de IA funciona inteiramente em servidores locais em vez de através de APIs externas.

Como o modelo e os dados permanecem internos, os documentos confidenciais nunca saem do ambiente da organização.

No entanto, a implementação de um LLM privado requer recursos informáticos significativos, incluindo GPUs de alto desempenho, uma grande memória de sistema e infraestrutura de IA dedicada.

Isto torna as implementações de LLM privados mais dispendiosas e tecnicamente exigentes do que as soluções baseadas em API, mas mais seguras se processar documentos altamente confidenciais ou sensíveis.

Como é que os documentos confidenciais são mantidos seguros dentro de um gestor documental?

As plataformas de gestão documental modernas, especialmente os sistemas ECM compatíveis com a IA como o Dokmee, utilizam várias camadas de segurança para preservar a confidencialidade dos documentos.

Acima de tudo, o Dokmee ECM possui uma arquitetura baseada em API que combina criptografia e registos de auditoria para processar tarefas de IA mantendo os dados confidenciais.

Os pedidos são transmitidos de forma segura, processados pelo motor de IA e devolvidos sem expor os documentos subjacentes a terceiros.

Esta arquitetura permite-lhe beneficiar da automação impulsionada pela IA enquanto protege os dados sensíveis dentro do ambiente ECM.

Ao utilizar as APIs de forma responsável, pode recorrer a tarefas de IA avançadas com um custo mínimo por pedido, mantendo os rigorosos padrões de privacidade exigidos para a gestão de conteúdo empresarial.

O Dokmee também utiliza estas 5 medidas de segurança para aumentar a privacidade:

1. Controlo de acesso baseado em funções (RBAC)

O RBAC aplica permissões granulares ao nível do documento, garantindo que apenas utilizadores autorizados possam visualizar, editar ou partilhar conteúdo.

Os departamentos e projetos podem ter restrições de acesso personalizadas, e o princípio do privilégio mínimo garante que os funcionários apenas acedam aos ficheiros necessários para as suas funções.

A privacidade da IA começa com políticas de controlo de acesso rigorosas dentro do gestor documental, formando a base de uma gestão segura do conteúdo empresarial.

2. Criptografia em repouso e em trânsito

Os documentos são criptografados tanto durante o armazenamento como durante a transmissão.

Os protocolos SSL (Secure Sockets Layer) e TLS (Transport Layer Security) protegem os dados que circulam pelas redes, enquanto a criptografia ao nível da base de dados protege a informação armazenada. Cópias de segurança criptografadas e o armazenamento na nuvem reduzem ainda mais os riscos.

A IA confidencial apoia-se em canais de dados criptografados para evitar a exposição durante o processamento, garantindo que mesmo os fluxos de trabalho impulsionados pela IA não possam comprometer o conteúdo sensível.

3. Classificação inteligente de documentos impulsionada por IA

A IA classifica automaticamente os documentos com base na sensibilidade do conteúdo, graças ao processamento de linguagem natural e à indexação por IA.

Através do uso de um processamento avançado de linguagem natural e do reconhecimento de padrões, a IA confidencial pode detetar informações proprietárias, dados de identificação pessoal ou propriedade intelectual, e aplicar políticas automatizadas para restringir o acesso.

A IA confidencial reforça a segurança dos documentos ao identificar e proteger automaticamente o conteúdo sensível, reduzindo assim o erro humano na etiquetagem ou no manuseamento de documentos confidenciais.

4. Monitorização do comportamento e deteção de anomalias

A privacidade da IA transforma a segurança do ECM de uma auditoria reativa para uma deteção proativa de ameaças.

Ao monitorizar os padrões de acesso aos ficheiros, os volumes de download e as alterações de permissões, a IA pode detetar anomalias como downloads em massa invulgares ou tentativas de acesso fora do horário normal de trabalho.

Isto permite aos administradores responder imediatamente a potenciais infrações ou utilizações indevidas.

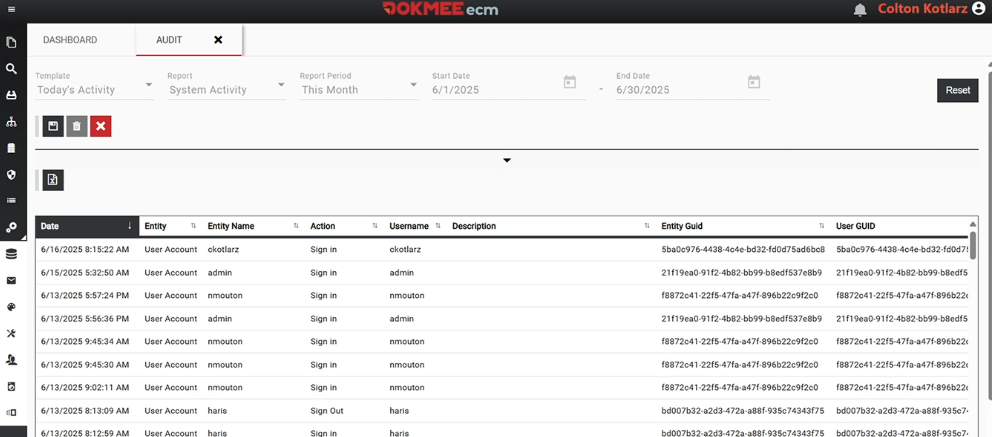

5. Trilhas de auditoria

O histórico completo dos documentos, os registos de atividade da IA e a responsabilidade ao nível do utilizador oferecem uma camada de segurança adicional.

As organizações podem rastrear cada ação realizada num documento, desde a visualização e edição até à partilha e eliminação, o que facilita os relatórios de conformidade e as investigações internas.

Além disso, as trilhas de auditoria não podem ser modificadas em momento algum.

Como o Dokmee apoia a privacidade da IA

Dokmee ECM é um excelente exemplo de uma plataforma de gestão de conteúdo empresarial pronta para IA que suporta a gestão confidencial de documentos empresariais.

Algumas das características de segurança incluem:

- Permissões de utilizador granulares que aplicam as políticas RBAC

- Opções de implementação seguras na nuvem e em instalações locais (on-premise)

- Padrões de criptografia avançados para dados em repouso e em trânsito

- Controlo de versões para proteger a integridade dos documentos

- Controlo de acesso baseado em fluxos de trabalho para processos de aprovação

- Partilha externa segura com proteção por palavra-passe, expiração e rastreio

Estas características garantem que as organizações possam implementar estratégias de IA confidencial sem sacrificar a facilidade de uso ou a eficiência dos fluxos de trabalho.

Proteja os seus dados com a privacidade da IA

A privacidade da IA responde aos seus desafios de segurança, protegendo os seus documentos e os seus fluxos de trabalho contra potenciais ameaças.

A automação inteligente mantém padrões rigorosos de privacidade e segurança.

Ao implementar controlos de acesso granulares, criptografia, classificação assistida por IA, ambientes de processamento seguros e uma auditoria completa, pode garantir que os seus documentos confidenciais permaneçam protegidos.

O Dokmee oferece um enquadramento moderno e pronto para IA para apoiar estas estratégias, tornando a IA confidencial uma vantagem estratégica na gestão de conteúdo empresarial.

Entre em contato com nossos especialistas em Enterprise ECM

Agende sua demonstração gratuita – a qualquer hora, em qualquer lugar

Experimente o ECM de nível empresarial sem taxas ocultas e com ROI instantâneo:

- Retorno de chamada instantâneo 24 horas por dia – você escolhe o horário.

- Personalizado de acordo com seus fluxos de trabalho – sem propostas padronizadas.

- ROI em 60 dias – a maioria das empresas recupera os custos rapidamente.

“O Dokmee reduziu nosso tempo de recuperação em 70% – vimos o ROI em 45 dias.”

Chad P., CTO